‘Wees voorbereid op alom aanwezige AI’

Er moeten zeker harde afspraken worden gemaakt over de inzet van AI. Maar laten we ons geen illusies maken over de effectiviteit van die regels, stelt Frans van Bruggen, lead Waarden, Normen en Regelgeving bij de AI Coalitie voor Nederland.

Onlangs riepen wetenschappers en politici op tot harde regels voor kunstmatige intelligentie (AI), zogeheten red lines. Als onderzoeker en lead Waarden, Normen en Regelgeving van AIC4NL onderschrijf ik deze oproep volledig. De investeringen in AI-infrastructuur zijn hoog, terwijl investeringen in AI-veiligheid achterblijven. AI-veiligheidsinitiatieven zijn belangrijk, al moeten we wel realistisch blijven over hun effectiviteit.

Serieuze wetenschappers, onder wie ook Nobelprijswinnaars, schatten het existentiële risico van AI op ongeveer 10 procent. Het risico bestaat, alleen weten we niet hoe het zich zal manifesteren. Dat maakt beheersing lastig. Tegelijk bevinden China en de VS zich in een door de landen zelf als existentieel ervaren race naar AI-suprematie. Die strijd gaat in essentie om geopolitieke macht.

We verkeren in een technologische transformatie die de komende 20 tot 25 jaar economie en samenleving diepgaand zal veranderen. Daarmee zijn macro-risico’s gemoeid die weliswaar geen existentieel risico vormen, maar wel reëler zijn.

Zorg voor slimme regulering, robuuste ethiek en wereldwijde stabiliteit

Het eerste is het systeemrisico. Wat gebeurt er wanneer slechts enkele grote foundation models de motor van de wereldeconomie vormen? In zo’n scenario leiden single points of failure en geopolitieke spanningen snel tot ontwrichting van vitale systemen. Ook grootschalige manipulatie wordt dan waarschijnlijker.

Het tweede risico betreft de arbeidsmarkt. We moeten werknemers voorbereiden op samenwerking met AI. Dat AI-agents en virtuele assistenten een vaste werkplek krijgen, lijkt onvermijdelijk, maar de transitie zal geleidelijk verlopen. Nu mislukt nog 95 procent van de pilots met generatieve AI, wat vooral bewijst dat technologie te vaak wordt ingezet als oplossing op zoek naar een probleem. Tegelijk is er te weinig aandacht voor de fundamentele vraag hoe generatieve AI hoog-cognitief werk kan ondersteunen of automatiseren. Dit vraagt om reflectie op processen, kennisborging, datakwaliteit en datamanagement; noodzakelijke, maar weinig glamoureuze voorwaarden voor succesvolle innovatie.

Het derde risico raakt aan de autonomie van werknemers. Wat betekent het om AI-collega’s te krijgen, of zelfs door een AI-agent te worden aangestuurd? In bijvoorbeeld de logistieke sector zien we al hoe het algoritme als baas schadelijke psychologische effecten kan veroorzaken. Het is aannemelijk dat dit ook in hoog-cognitieve beroepen zal optreden.

De risico’s dwingen ons tot herbezinning. Dat begint met een vorm van governance, in de vorm van mondiale afspraken om escalatie tussen grootmachten te beperken en de ontwikkeling van veilige modellen te stimuleren. Tegelijk moeten we in Europa en Nederland inzetten op proportionele regulering: regels die de risico’s aanpakken, maar zonder de innovatie te verstikken. Ten slotte vraagt een samenleving met alom aanwezige AI om een sterke ethische infrastructuur: instellingen die waarden vertalen naar ontwerpkeuzen, bedrijven die verantwoordelijkheid nemen voor hun systemen, publieke organisaties met kennis en capaciteit om AI te begrijpen en te sturen. Alleen met deze combinatie van wereldwijde stabiliteit, slimme regulering en robuuste ethiek kunnen we de voordelen van AI benutten zonder de fundamenten van onze maatschappij op het spel te zetten.

Tekst: Frans van Bruggen, lead Waarden, Normen en Regelgeving bij de AI Coalitie voor Nederland (AIC4NL).

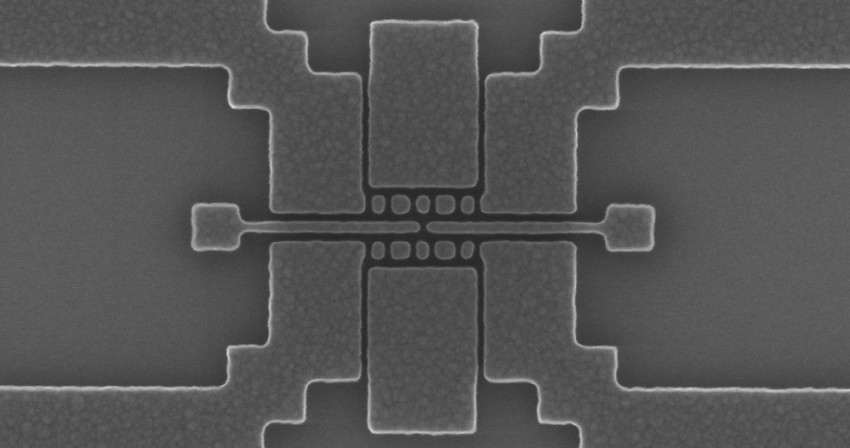

Beeld: Rose Willis & Kathryn Conrad / https://betterimagesofai.org/ https://creativecommons.org/licenses/by/4.0/