Navigatie-systeem voor robotoperaties

Opereren met een robot vraagt het uiterste van chirurgen. Een ‘navigatiesysteem’ dat toont waar welke organen en weefsels zitten kan hen daarbij helpen.

Onderzoekers van het UMC Utrecht en de Technische Universiteit Eindhoven werken aan zo’n systeem. ‘Google Maps voor chirurgen’, noemen ze het zelf. Niet bedoeld om blind op te vertrouwen, maar het is wel erg handig om te weten waar je je ongeveer bevindt.

Operatierobot

Om het nut van het systeem te begrijpen eerst even een stap terug. In de academische ziekenhuizen, en enkele grotere streekziekenhuizen, voeren chirurgen sommige typen operaties uit met behulp van een operatierobot, meestal van het merk DaVinci. Dit is een complex apparaat dat, anders dan de naam doet vermoeden, niet autonoom aan het opereren gaat. Een operatierobot is een systeem waarbij de chirurg op de ene plek, de ‘master’, aan hendels zit te duwen, trekken en draaien, terwijl al die bewegingen worden vertaald in bewegingen van de instrumenten die in de patiënt zitten (de ‘slave’).

Kleine gaatjes

Voordeel van een robotoperatie is dat de patiënt niet helemaal open wordt gemaakt. Het is een kijkoperatie, ook wel ‘laparoscopische operatie’, waarbij de instrumenten en een minuscule camera door kleine gaatjes naar binnen gaan. Hierdoor krijgt het lichaam een minder grote klap te verwerken en herstelt de gemiddelde patiënt sneller dan bij een open operatie. De chirurg vaart er overigens ook wel bij, omdat die niet meer urenlang in moeilijke houdingen hoeft te staan.

Moeite om zich te oriënteren

Er is alleen wel een forse uitdaging voor de chirurg. Bij een open operatie zou die alle organen en weefsels goed zien zitten, maar bij een robotoperatie worden de beelden gemaakt door een camera die van dichtbij filmt. ‘Die camerabeelden zijn zover ingezoomd, dat de chirurg soms moeite heeft om zich te oriënteren’, vertelt Yasmina Al Khalil van de TU Eindhoven. Zij is elektrotechnisch ingenieur, gepromoveerd in de biomedische technologie en specialiseerde zich de laatste jaren in computer vision en AI voor medische toepassingen.

Meekijken met ervaren chirurgen

De techniek is om die reden lastig te leren. De chirurg kijkt op de haarscherpe camerabeelden, maar daarop lijken alle weefsels behoorlijk op elkaar. ‘Om deze manier van opereren te leren kijken studenten mee met ervaren chirurgen. Maar ze moeten minstens tachtig en soms meer operaties bijwonen voordat ze zelf – onder begeleiding – mogen opereren.’ Het laat zien hoe groot de rol is die ervaring hier speelt.

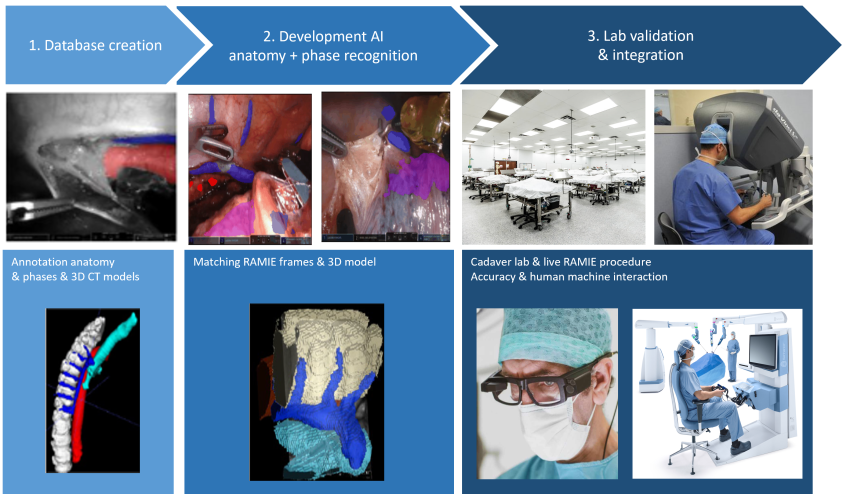

Augmented reality-laag

Zou er geen grafische manier mogelijk zijn om de chirurg – beginnend zowel als ervaren – te ondersteunen bij deze complexe operaties? Dat is wat chirurg Jelle Ruurda van het UMC Utrecht zich afvroeg. Samen met een voorganger van Al Khalil zette hij daarvoor het project IntraSurge op. Het doel: een augmented reality-laag creëren, waarmee de chirurg in één oogopslag te zien krijgt waar in het lichaam de camera zit, hoe de oriëntatie van het beeld is en waar welke organen en weefsels zitten.

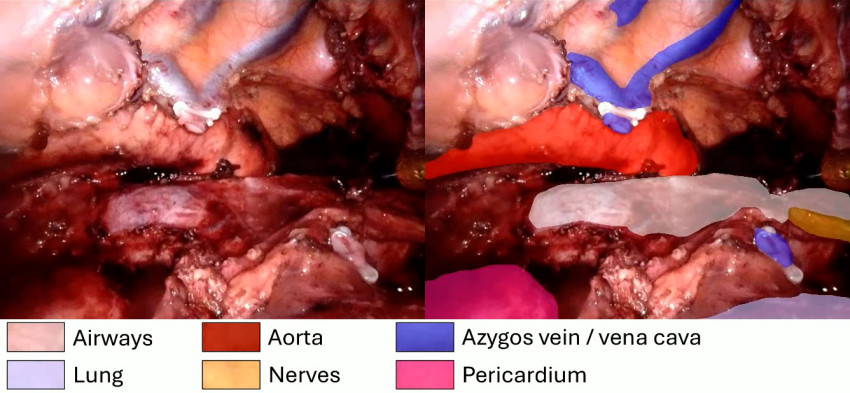

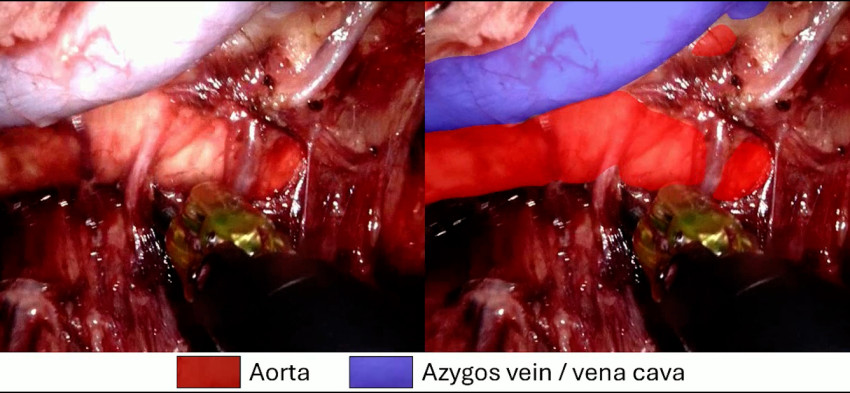

Verschillende kleuren

De eerste resultaten zijn er inmiddels. Op beelden is te zien hoe op camerabeelden automatisch verschillende kleuren verschijnen, die horen bij bepaalde weefsels. Aorta, zenuwen, longweefsel, ze krijgen allemaal een andere kleur. Het berekenen van die graphics gaat met 32 frames per seconde, sneller dan de ingenieurs vooraf hadden gedacht. ‘Daardoor worden de beelden zelfs realtime bijgewerkt’, zegt Al Khalil.

Feedback van chirurgen

Hoewel het IntraSurge-team nog lang zo ver is niet is als het wil zijn, worden de eerste resultaten positiever door chirurgen beoordeeld dan vooraf verwacht, zegt Al Khalil. ‘We gebruiken de feedback van de chirurgen ook om ons systeem te verbeteren en aan te passen. De kleurenbeelden zijn nu te zien op een apart beeldscherm bijvoorbeeld, en op verzoek zijn we van plan een knop in te bouwen waarmee de chirurg de verklarende graphics aan- of uit kan zetten.’

Trainen van het AI-systeem

Een van de grootste uitdagingen voor Al Khalil en haar mensen is het trainen van het AI-systeem dat de gekleurde graphics genereert – en dus feitelijk zegt: dit hier is een zenuw en dat daar is de slagader. Tot nu toe is dit trainen gedaan door ervaren chirurgen naar honderden en honderden stilstaande beelden van een operatiecamera te laten kijken en de organen en weefsels met de hand te laten labellen. Maar deze aanpak is, voor een verdere verbetering van het AI-model, niet houdbaar. ‘Ten eerste omdat chirurgen hier eigenlijk helemaal geen tijd voor hebben’, zegt Al Khalil. Maar daarnaast is het ook belangrijk dat het AI-algoritme een soort geheugen krijgt ingebouwd. Alleen losse frames analyseren, zoals het nu nog gebeurt, levert ongewenste fouten op. ‘Organen in beeld bewegen nu eenmaal, alleen al doordat de patiënt ademt. Ons systeem moet gaan “weten” wat het zag in eerdere beelden om bewegende onderdelen goed en betrouwbaar te kunnen labelen.’

Een stap in de juiste richting zette het team door het AI-model te trainen met video’s van operaties die online werden gevonden. Al Khalil: ‘Dat waren niet eens dezelfde soort operaties als die binnen ons project, maar het maakte ons model toch beter in het herkennen van verschillende organen.’

Taalmodel

Een volgende stap hopen de onderzoekers te zetten door het AI-model meer informatie te gaan voeren over de operatie zelf. Bij een patiënt met slokdarmkanker, bijvoorbeeld, gaat de chirurg met de robot volgens een bepaalde aanpak te werk. De operatie is opgedeeld in twaalf fasen, vertelt Al Khalil, en elke fase weer in een paar stappen. ‘Het is voor het systeem van cruciaal belang om te weten in welke stap de operatie zich bevindt. We willen nu een groot taalmodel gaan gebruiken om de operatievolgorde aan het AI-model te voeden. Daardoor “weet” ons systeem straks: als de chirurg met zijn instrument aan het snijden is in een bepaald orgaan, dan moet dit stap drie in fase vier zijn. Daarmee gaat de betrouwbaarheid van onze beelden omhoog.’

Openingsbeeld: zo ziet werken met een operatierobot eruit. De chirurg zit aan een master-systeem, terwijl de instrumenten verderop in het lichaam van de patiënt zitten. Illustratie: Intuitive.com