Playbackend robotgezicht praat als een mens

De lippen van mensachtige robots bewegen vaak houterig. Onderzoekers in de VS brengen daar nu verbetering in.

Mensachtige robots kennen we al lang. Doordat ze aan de ene kant duidelijk op ons lijken, maar aan de andere kant op belangrijke kenmerken toch net niet realistisch genoeg zijn, geven ze ons een unheimisch gevoel. Er is zelfs een naam voor de afkeer die dan ontstaat: de uncanny valley, ofwel de griezelvallei. Die belemmert de inzet van humanoïde robots.

Horeca

Een groep robotwetenschappers gelooft dat er wel degelijk nuttige toepassingen zijn voor op mensen lijkende robots. In de ouderenzorg bijvoorbeeld of als ondersteuning in de horeca of het hotelwezen.

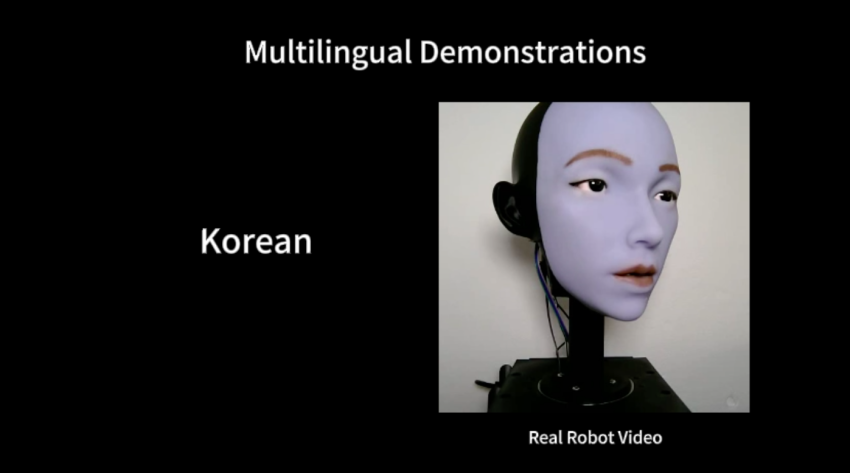

Zo ook een team ingenieurs en robotica-experts aan Columbia University in New York. Zij publiceerden woensdag in het vaktijdschrift Science Robotics ($) over hun werk aan een robotgezicht dat behoorlijke realistische bewegingen kan maken met de mond.

Kijken naar de lippen

Doel is om in de buurt te komen bij wat de menselijke mond doet wanneer iemand praat, en zo robots beter verstaanbaar (en betrouwbaarder) te maken.

Wanneer mensen naar een ander luisteren, wordt een verrassend groot deel verzorgd door het kijken naar de lippen. Hoe meer hinderlijke bijgeluiden - hoe rumoeriger een ruimte - hoe belangrijker het interpreteren van de lipbewegingen is.

Bekijk het zelf in deze video:

Getuite mond

De groep aan Columbia University bouwde een robotgezicht dat bestaat uit een voorzijde van zacht siliconenrubber, met daarachter actuatoren - gebaseerd op elektromotoren - die bij elkaar de mond tien vrijheidsgraden geven. Deze opzet maakt complexere bewegingen van de lippen mogelijk dan bij andere robotgezichten.

Elke mondhoek wordt bijvoorbeeld aangestuurd door een elektromotor die een beweging in twee richtingen mogelijk maakt: zowel naar binnen als naar buiten. De tien vrijheidsgraden zorgen er tezamen voor dat de mond allerlei vormen kan aannemen, zoals een getuite mond. Ook bijzonder, schrijven de onderzoekers in hun artikel, is dat de robotmond helemaal kan sluiten, ‘wat essentieel is voor realistische lipbewegingen’.

Alle mogelijke talen

Is de mechanische kant van het verhaal al indrukwekkend, minstens zoveel werk stak de groep in het natuurgetrouw laten bewegen van de mond bij alle mogelijke klanken. Hiervoor werd een AI-model getraind, net zolang tot bekend is welke bewegingen de motoren moeten maken voor een bepaalde stand van de lippen.

Het bijzondere is dat de robot hierdoor alle mogelijke talen kan ’spreken’, zelfs wanneer die geen onderdeel waren van de training, zoals Frans, Chinees en Arabisch.

‘We hebben het taalprobleem omzeild door een model te trainen dat rechtstreeks van audio naar lipbewegingen gaat’, zei onderzoeksleider Hod Lipson tegen de website CNET. ‘Er is geen sprake van taal.’ Alleen van bepaalde klanken en daarbij de juiste mondbewegingen. Perfect is het nog niet, maar wel beter dan veel andere robots die doen alsof ze praten.

Ongemakkelijk gevoel

Nog even over the uncanny valley, dat ongemakkelijke gevoel dat mensen hebben als een robot eruit ziet als een mens, maar net niet realistisch genoeg is. De hoofdreden hiervoor is dat veel mensachtige robots hun mond niet of nauwelijks bewegen wanneer ze praten. ‘Wij proberen dit probleem juist op te lossen’, zei Lipson tegen CNET. ‘Het is lang verwaarloosd in de robotica.’

Openingsbeeld: video still van de pratende robot. Foto: Yuhang Hu