Kunstmatige intelligentie gemakkelijk te foppen

Beeldherkenning door kunstmatige intelligentie raakt volledig van slag als het beeld verstoord wordt. Het roept de vraag op of kunstmatige intelligentie wel robuust genoeg is.

Beeldherkenning geldt als dé doorbraak van kunstmatige intelligentie. De Stanford University begon rond 2010 met de opbouw van ImageNet, een dataset met (op dit ogenblik) 14 miljoen plaatjes, die allemaal zijn voorzien van een omschrijving met wat er op is te zien. Neurale netwerken worden met die dataset getraind om plaatjes te herkennen, en dat uiteindelijk beter te doen dan mensen. Algoritmen zijn zo in staat om een kat te herkennen, niet alleen als die recht in de lens kijkt, maar ook als hij of zij opgerold in een mandje ligt of in een andere rare positie op de foto staat.

Vervorming

Maar hoe robuust is die beeldherkenning? Wat als een plaatje een beetje wordt vervormd, is de herkenning dan nog even goed?

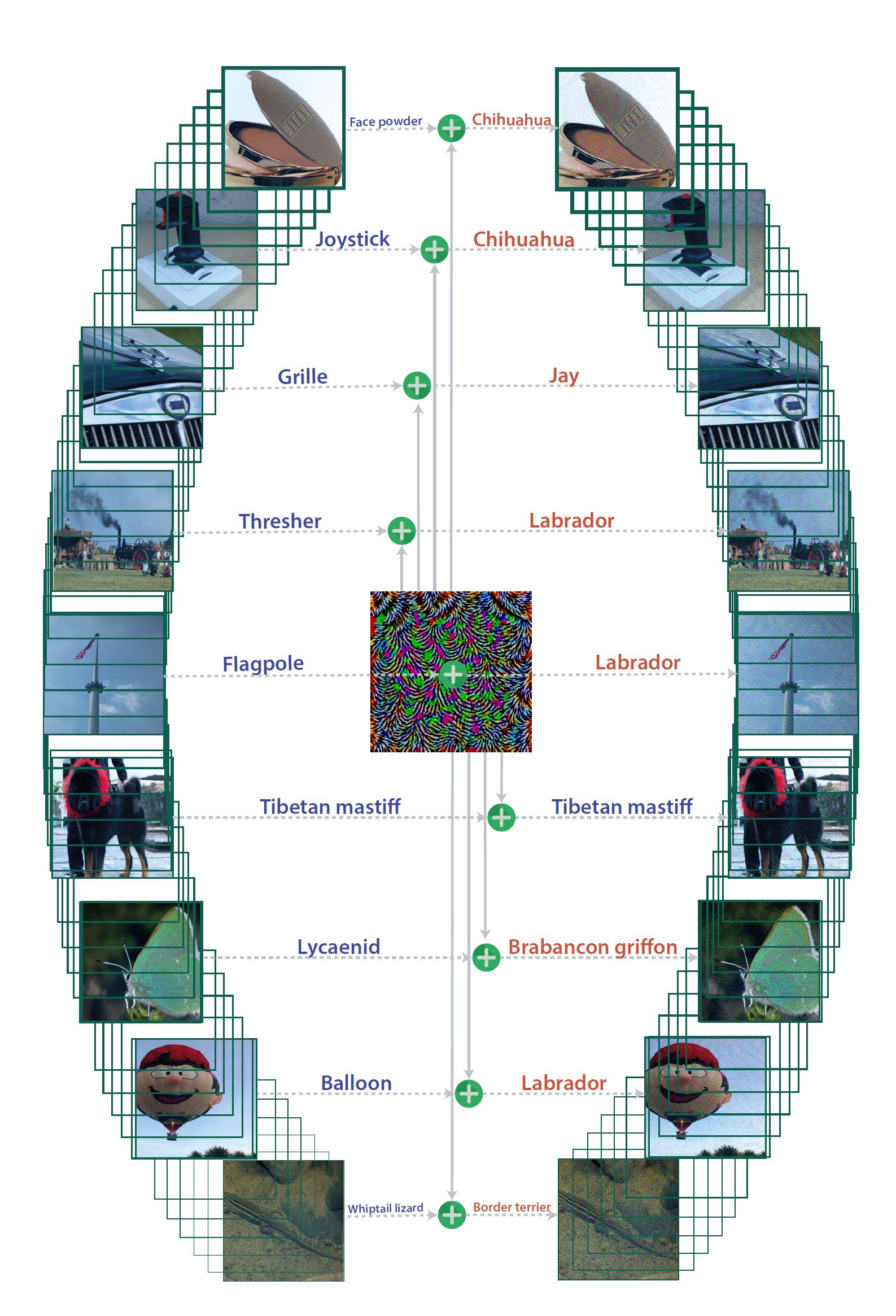

Om dat te testen ontwikkelden onderzoekers van de Zwitserse Ecole Polytechnique Fédérale de Lausanne (EPFL) een universeel verstoringsalgoritme. Dat vervormt plaatjes een klein beetje. De term 'universeel' gebruiken ze omdat de vervorming los staat van de specifieke afbeelding op het plaatje. Het algoritme verstoort de afbeeldingen ogenschijnlijk maar een klein beetje, en legt er een vrijwel onzichtbare laag overheen te leggen die donkere vlekken en valse kleuren toevoegt.

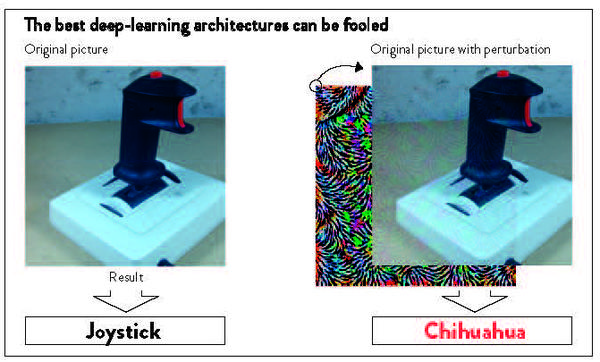

Voor het menselijk oog blijft dat vervormde plaatje uitstekend herkenbaar; het heeft hooguit wat meer vlekken. De kunstmatige intelligentie heeft er duidelijk moeite mee. Plotseling wordt een joystick aangezien voor een Chihuahua, en een vlaggenstok voor een labrador. (zie de afbeelding hieronder)

Het is opvallend hoe kwetsbaar beeldherkenning blijkt te zijn. Als een van de verklaringen noemen de onderzoekers dat de algoritmen vooral op zoek zijn naar randen, en de vlekken daar kennelijk ook voor aanzien.

Een tegenwerping kan zijn dat de verstoring kunstmatig is aangebracht. Maar naarmate er meer toepassingen worden gezocht voor kunstmatige intelligentie neemt ook de kans toe dat het te analyseren materiaal op een bepaalde manier is vervormd.

De onderzoekers willen vooral testen hoe robuust de uitkomst van kunstmatige intelligentie is, zo laten ze in een interview op de website van EPFL weten. Bij toepassingen in de gezondheidszorg, bijvoorbeeld het herkennen van tumoren op MRI-scans, is het essentieel dat de software geen fouten maakt. ‘We moeten dus goed begrijpen wat de beperkingen van de kunstmatige intelligentie-systemen zijn en wanneer ze de mist in gaan. Dan kunnen we ze robuuster maken en de garantie hebben dat het resultaat ook klopt.’

De onderzoekers stellen de code die ze gebruikten gratis beschikbaar, zodat iedereen er gebruik van kan maken om zijn algoritmen te testen.