Verantwoord techniek verkopen

Een Nederlands bedrijf verkocht software die emoties op gezichten herkent aan een Chinees ministerie terwijl bekend is dat China een surveillancestaat inricht. In hoeverre moet een bedrijf weten wat een afnemer met een product gaat doen?

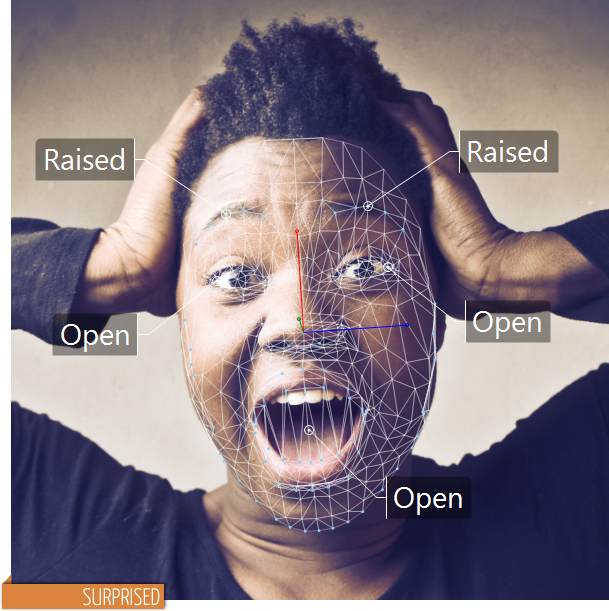

Het Nederlandse bedrijf Noldus Information Technology heeft in 2016 software voor het herkennen van emoties op gezichten verkocht aan het Chinese ministerie van Openbare Veiligheid, zo bracht de website De Correspondent vorige maand aan het licht. Dit programma, FaceReader, is ontwikkeld door het eveneens Nederlandse VicarVision.

De teneur van het artikel: dat had Noldus niet moeten doen, want China is een surveillancestaat aan het inrichten. Het land trekt alle technologie uit de kast om minderheden en dissidenten in de gaten te houden.

Alleen voor trainingen

Maar draagt FaceReader daar echt aan bij? Volgens Noldus gebruiken de Chinezen het programma alleen voor trainingen, zoals het oefenen van gesprekken tussen mensen in stressvolle situaties. Of het meten van de emoties van iemand die een test op een computer doet. ‘FaceReader is niet bedoeld om mensen te identificeren of voor surveillance. Dat kan het programma ook helemaal niet’, zegt een woordvoerder van Noldus.

De Chinese klant kocht de software destijds bovendien met één licentie. Om FaceReader te kunnen draaien, moet je een dongel in je usb-poort stoppen, zodat je het steeds op maar één computer kunt gebruiken. Ook dat sluit uit dat het programma voor surveillance wordt ingezet, zegt de Noldus-woordvoerder.

Geen updates

Toch roept de kwestie de vraag op in hoeverre een bedrijf zich eigenlijk moet verdiepen in wat een afnemer met een product gaat doen. ‘Bedrijven zouden moeten nadenken over de waarschijnlijkheid waarmee afnemers hun product voor onverantwoorde doelen gaan gebruiken, zoals mensenrechtenschendingen en de mogelijke schade die dergelijke toepassingen opleveren’, zegt Cas Michiels, advocaat bij Stibbe, die vorig jaar onderzoek deed naar onverantwoord gebruik van producten. ‘Zoiets staat wel al onder meer in richtlijnen van de Verenigde Naties, maar die zijn niet bindend. Wat overigens niet betekent dat ze in een gerechtelijke procedure geen rol kunnen spelen.’

Als het vermoeden rijst dat een potentiële klant een product voor ethisch onwenselijke zaken wil gebruiken, kan een bedrijf besluiten om de verkoop af te blazen. ‘Dat kost even wat omzet, maar als later uitkomt dat je product is gebruikt om mensenrechten te schenden, loopt je bedrijf reputatieschade op’, zegt hoogleraar Martijn Scheltema van de Erasmus Universiteit Rotterdam. ‘Dat kan een bedrijf op termijn veel geld kosten.’

Clausule in contract

En kan een bedrijf ook voorkomen dat een product op een ethisch verkeerde manier wordt ingezet? ‘Je kunt een clausule in het koopcontract opnemen. Houd de koper zich daar niet aan, dan kun je dat in principe aanvechten bij de rechter’, zegt Scheltema. De vraag is in dit geval wel hoe groot de kans op succes is als je dat bij een Chinese rechter zou doen. Bij software zou je de klant ook geen updates meer kunnen geven als die het product verkeerd gebruikt. ‘Maar het blijft lastig om echt te checken wat er met je product gebeurt.’

Michiels zag in zijn afstudeeronderzoek afgelopen jaar dat nog niet veel bedrijven vooraf onderzoek doen naar wat de mogelijke afnemer met hun product gaat doen. ‘Maar het gebeurt wel steeds meer. Nu zijn het vooral enkele grotere bedrijven die hiermee bezig zijn. Het lijkt mij voor producenten raadzaam om hierover met afnemers in gesprek te gaan.’

'Achteraf niet handig'

Achteraf gezien was het niet handig om FaceReader te verkopen aan het Chinese ministerie van Openbare Veiligheid, geeft de Noldus-woordvoerder toe. ‘Het heeft geleid tot negatieve verhalen in de pers, ook al hebben we vooraf gevraagd wat het doel van het onderzoek was en daarop een antwoord gekregen’, zegt de woordvoerder. ‘Zoveel hebben we er ook niet aan verdiend; een licentie kost zo’n 9000 euro. Zou de vraag nu komen uit China, dan zou ik de verkoop heroverwegen.’

Foto: Depositphotos