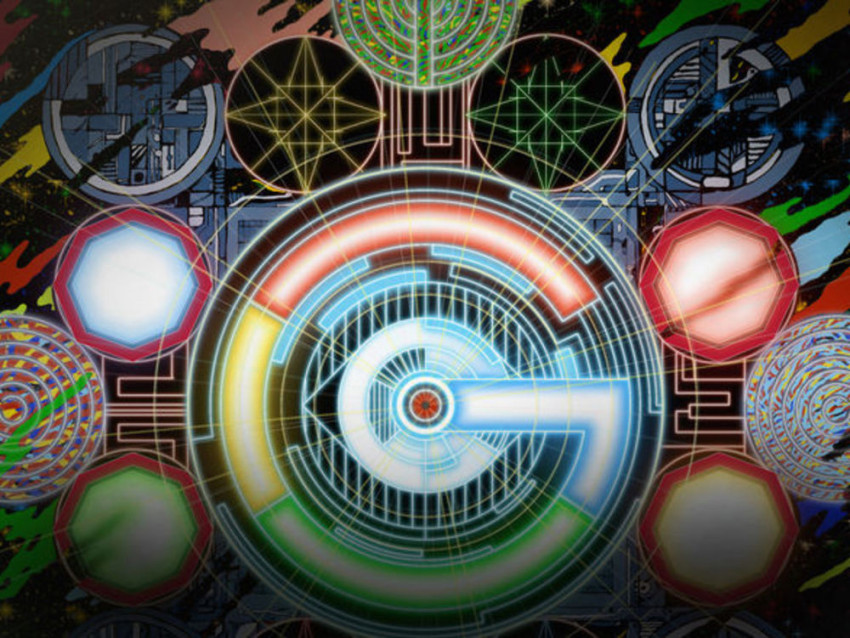

Google stopt met militaire AI-samenwerking

Google gaat niet verder met zijn AI-dienstverlening aan het Amerikaanse ministerie van defensie, zo maakte het bedrijf bekend. Binnen Google was veel beroering ontstaan over die samenwerking.

Google-CEO Sundar Pichai presenteerde gisteren zijn blog AI at Google: our principles. Daarin ontvouwt het bedrijf de maatschappelijke uitgangspunten die het wil hanteren bij de ontwikkeling van kunstmatige intelligentie, een vakgebied waarin Google een van de grote spelers is. Eerder deze week liet de Google-directie zijn medewerkers weten dat het contract met defensie dat gaat over beeldherkenning, niet zal worden verlengd wanneer het volgend jaar is afgelopen. Die samenwerking leidde binnen Google tot veel ophef.

Pichai signaleert in zijn blog dat AI een zeer krachtig instrument is, met mogelijk verstrekkende maatschappelijke consequenties, waarin Google zijn verantwoordelijkheid wil nemen. Uiteraard gaat dat in algemene termen als welvaartsbevorderend, betrouwbaar, verantwoordelijk en privacybevorderend.

Rupsje Nooitgenoeg

Dat laatste geeft meteen al de zwakte van algemene principes weer, want op dit ogenblik verhouden Google en privacy zich als Rupsje Nooitgenoeg tot alles wat eetbaar is.

Tegelijkertijd geven dit soort richtlijnen wel een kompas waaraan activiteiten van Google zijn te toetsen. Zo noemt Pichai in zijn blog ook een aantal activiteiten die Google per se niet wil met kunstmatige intelligentie, zoals toepassingen die mensen schade berokkenen, dodelijke wapens of dingen die in strijd zijn met internationale mensenrechtenverdragen.

En ook niet onbelangrijk: de blog van de Google-CEO geeft aan dat de top van het bedrijf gevoelig is voor de discussie die afgelopen weken onder zijn eigen medewerkers ontstond als uitdrukking van een groter levende weerzin tegen het gebruik van AI voor wapensystemen.