Camera met maar één pixel

MIT-onderzoekers hebben een camera ontworpen met maar één pixel en zonder lenzen, die toch prima beelden maakt. Helemaal nieuw is het idee niet, maar het apparaat dat MIT-onderzoekers hebben bedacht, werkt veel efficiënter dan eerdere varianten. 1-Pixel-camera’s kunnen handig zijn bij golflengtes van licht waar lenzen niet mee overweg kunnen of op locaties waar lenzen kwetsbaar zijn.

De meeste digitale camera’s hebben een chip aan boord met daarop miljoenen lichtsensoren. Licht valt binnen via een lens die een beeld focusseert in het vlak van de chip.

Dat kan ook anders, dachten ze bij het Massachusetts Institute of Technology in de Verenigde Staten. Daar bouwden ze een camera die geen lens meer nodig heeft, omdat hij maar één pixel (lichtgevoelig element) aan boord heeft.

Lichtflits

Nu kun je met één beeldpunt natuurlijk geen plaatje opbouwen, dus dat moesten de onderzoekers op een andere manier oplossen: in de tijd.

Dit is het principe: het apparaatje stuurt een korte lichtflits naar buiten. Dit licht weerkaatst op voorwerpen die zich op verschillende afstanden van de camera bevinden zodat de weerkaatste lichtpulsjes kort na elkaar naar binnen komen op de sensor. Zie plaatje hieronder:

Met deze techniek, die time of flight imaging wordt genoemd, vormt zich een eerste aanzet voor een beeld van de omgeving. Alleen is één beeld nog niet voldoende voor een goed resultaat, want uit de opeenvolging van lichtpulsen wordt niet duidelijk uit welke richting het licht kwam.

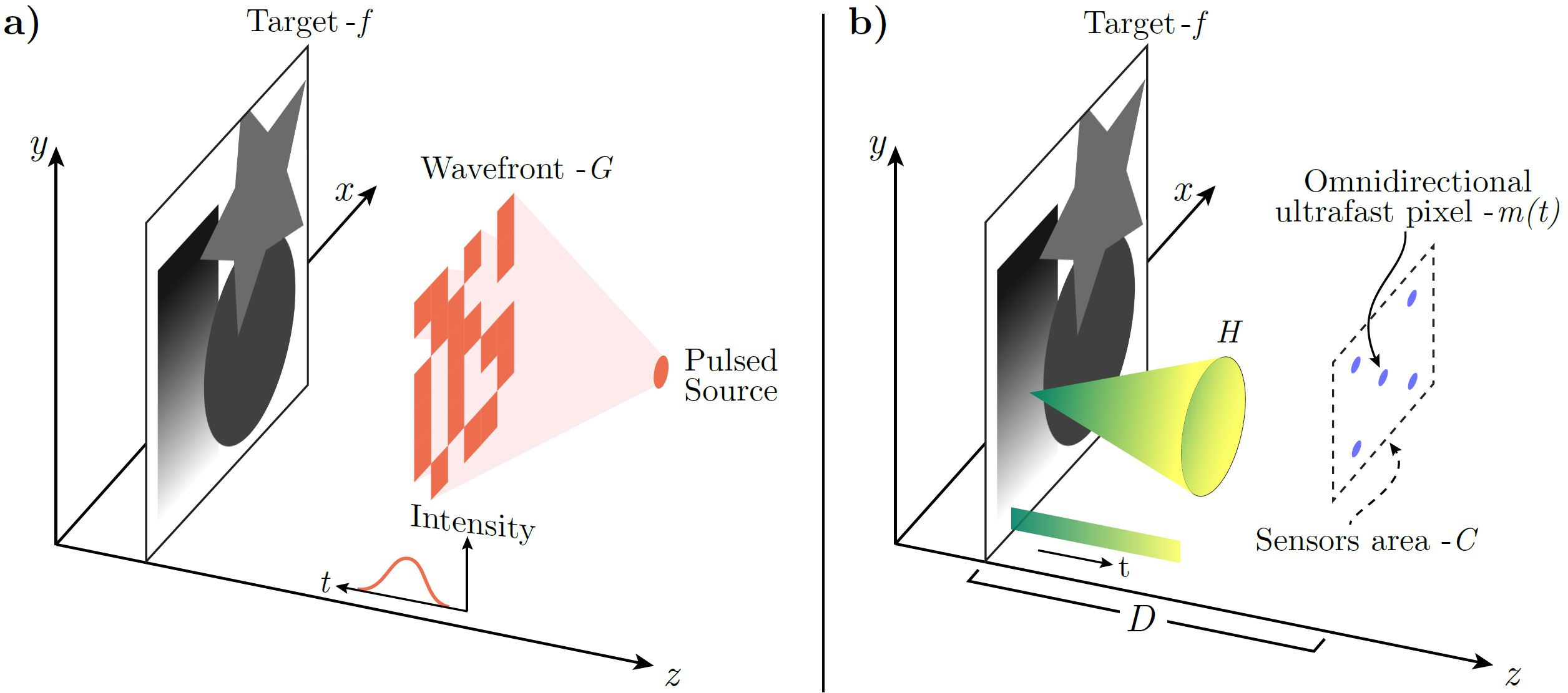

Daarom halen de onderzoekers een truc uit, waarbij de camera steeds een aantal lichtpulsen kort achter elkaar uitzendt, waarbij er steeds een ander rooster voor de lichtbron staat (zie afbeelding hieronder). Het rooster lijkt op een niet ingevuld kruiswoordpuzzel, met vakjes die willekeurig wit of zwart zijn gemaakt. Die patronen zorgen er zo voor dat er per opname verschillende details uit het beeld naar voren komen. Het licht kwam immers steeds uit verschillende richtingen.

Links: Een rooster voor een puntbron zorgt voor een complex (en elke keer weer ander) golffront, dat uit de camera komt.

Rechts: Licht valt op het doelwit en vanuit elk punt kaatst licht terug, dat valt op de beeldsensor (een blauwe punt). Die meet een opeenvolging van lichtpulsen, die iets zeggen over de omgeving. Door dit hele proces enkele tientallen keren te doorlopen, ontstaat een heldere opname van de omgeving. Overigens fungeert de camera al met één beeldsensor, maar wordt de beeldkwaliteit wel beter als er meerdere beeldsensoren zover mogelijk uit elkaar worden geplaatst; vandaar de vijf blauwe punten.

Hier vervangt time of flight imaging dus in feite de traditionele situatie – één lichtmeting met één lichtpatroon – door enkele tientallen lichtmetingen die extreem kort achter elkaar plaatsvinden, binnen een fractie van een seconde. Dat lijkt misschien overdreven ingewikkeld doen, maar het feit dat je goede opnames kunt maken zonder lens, heeft voordelen voor bepaalde toepassingen. Denk bijvoorbeeld aan licht met golflengtes waarbij lenzen lastig te maken zijn, zoals terahertz- of infraroodstraling.

Meerdere beeldsensoren

De onderzoekers benadrukken dat het principe van de 1-pixel-camera zeker kan werken, maar dat de kwaliteit van de opname beter wordt als er meerdere beeldsensoren worden gebruikt. En hoe verder die pixels uit elkaar staan, hoe minder overlap er is in de beelden die ze maken; en hoe minder opnames je nodig hebt voor het maken van een beeld van gelijke kwaliteit.

Meer details zijn te lezen in een nieuwsbericht van MIT en op de pagina van onderzoeker Guy Satat.

Openingsbeeld een camera obscura, één van de eerste cameratypen. Die werkt met een pinhole, een piepklein gaatje waar het licht doorheen valt. Alle beeldmateriaal: Guy Satat, MIT